企业首选主流 AI 算力

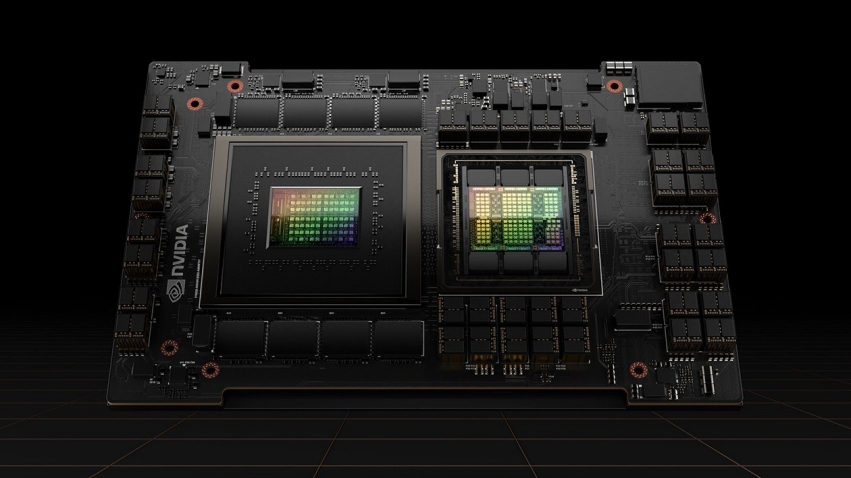

NVIDIA HGX H100 GPU 租赁

释放企业级 AI 训练与推理性能

基于 NVIDIA Hopper 架构的成熟算力方案

企业级算力

企业级 AI 计算首选:H100

基于 NVIDIA Hopper 架构,H100 是当前主流大模型训练与高性能推理的核心算力基础。

无论是百亿级模型训练、分布式微调,还是高并发推理服务,H100 都能提供稳定、成熟、广泛生态支持的 GPU 算力环境。

选择适合您的配置

灵活的部署方案,满足不同业务需求

H100 云服务器

- 单卡 / 多卡实例可选

- 分钟级启动

- 支持按需 / 包月 / 包年计费

- 适合弹性扩容与测试环境

H100 8卡集群

- 8× H100 SXM

- NVLink 高速互联

- 3.2 TB/s GPU互连带宽

- 25Gbps 私有网络

- 10Gbps+ 公网带宽

- 裸金属配置见下方技术规格

数据中心:北美、欧洲

交付形式:裸金属 / 虚拟化

应用场景

H100 适合哪些场景?

大模型预训练(LLaMA / Mistral / DeepSeek 系列)

多卡分布式微调

企业私有大模型部署

多租户推理服务

强 CUDA 生态依赖项目

成本节省

- 成本最高节省 30%–70%

- 账单透明,无隐藏网络费

弹性扩容

- 支持短期弹性扩容

- 支持 Kubernetes

企业级服务

- 符合 HIPAA 和 SOC 2标准的产品

- 由企业级SLA和值得信赖的24/7 全天候支持团队提供支持,确保您的在线服务

- 提供架构级部署建议

- 专属技术支持

技术规格

H100 GPU 服务器技术规格

多种配置选项,满足不同规模的 AI 训练与推理需求

| 规格项 | H100 8卡 裸金属 | H100 8卡 云主机 | H100 单卡 云主机 |

|---|---|---|---|

| GPU | NVIDIA HGX H100 80GB 700W SXM5 GPUs, fully interconnected with NVIDIA NVLink technology | NVIDIA H100 SXM5 GPUs*8, 80GB* 8 640GB HBM3 Memory | NVIDIA H100 SXM5 GPU 80GB HBM3 Memory |

| CPU | 96 cores 192 Threads Intel(R) Xeon(R) Platinum 8468 *2, 4th Gen Intel® Xeon® Scalable Processors | 160 VCPU | 20 VCPU |

| 内存 | 2048GB(64GB*32) | 1920GB | 240GB |

| 本地存储 | 7TB 2.5-inch NVMe SSD drives*8 | 2TB系统盘,40TB NVMe SSD本地盘 | 720GB系统盘,5TB NvMe SSD本地盘 |

| GPU互联网络 | Mellanox Network Adapter MT2910 Family ConnectX-7, 400Gbps*8 支持NVLINK RoCE2 3.2Tbs(400Gbps*8) RoCE2 | 支持NVLINK,RoCE2 3.2Tbs(400Gbps*8) RDMA网络 | - |

| 以太网络 | Mellanox Technologies MT2892 Family [ConnectX-6 Dx] ; link speed 100Gps*4 | - | - |

| 私有网络 | 最高400Gbps | 25Gbps | 25Gbps |

| 公有网络 | 最高40Gbps | 10Gbps | 10Gbps |

| 赠送出网流量 | 不限流量 | 60TB | 15TB |

| 计费模式 | 包年、包月 | 包年、包月、按需 | 包年、包月、按需 |

* 规格如有变动,以实际交付为准

NVIDIA HGX H100 技术规格

| H100 SXM | Specification |

|---|---|

| FP64 | 34 teraFLOPS |

| FP64 Tensor Core | 67 teraFLOPS |

| FP32 | 67 teraFLOPS |

| TF32 Tensor Core* | 989 teraFLOPS |

| BFLOAT16 Tensor Core* | 1,979 teraFLOPS |

| FP16 Tensor Core* | 1,979 teraFLOPS |

| FP8 Tensor Core* | 3,958 teraFLOPS |

| INT8 Tensor Core* | 3,958 TOPS |

| GPU Memory | 80GB |

| GPU Memory Bandwidth | 3.35TB/s |

| Decoders | 7 NVDEC 7 JPEG |

| Max Thermal Design Power (TDP) | Up to 700W (configurable) |

| Multi-Instance GPUs | Up to 7 MIGS @ 10GB each |

| Form Factor | SXM |

| Interconnect | NVIDIA NVLink™: 900GB/s PCIe Gen5: 128GB/s |

| Server Options | NVIDIA HGX H100 Partner and NVIDIA- Certified Systems™ with 4 or 8 GPUs NVIDIA DGX H100 with 8 GPUs |

| NVIDIA AI Enterprise | Add-on |

性能对比

性能对比

全面对比不同 GPU 型号的技术规格和性能指标

| GPU型号 | GPU显存 | 内存 | vCPU | 启动磁盘 | 临时磁盘 | 架构 |

|---|---|---|---|---|---|---|

| AMD Instinct™ MI350X | 288 GB | 256 GiB | 24 | 720 GiB NVMe | 5 TiB NVMe | CDNA 4™ |

| AMD Instinct™ MI350X×8 | 2,304 GB | 2,048 GiB | 192 | 2,046 GiB NVMe | 40 TiB NVMe | CDNA 4™ |

| AMD Instinct™ MI325X* | 256 GB | 164 GiB | 20 | 720 GiB NVMe | 5 TiB NVMe | CDNA 3™ |

| AMD Instinct™ MI325X×8* | 2,048 GB | 1,310 GiB | 160 | 2,046 GiB NVMe | 40 TiB NVMe | CDNA 3™ |

| AMD Instinct™ MI300X | 192 GB | 240 GiB | 20 | 720 GiB NVMe | 5 TiB NVMe | CDNA 3™ |

| AMD Instinct™ MI300X×8 | 1,536 GB | 1,920 GiB | 160 | 2,046 GiB NVMe | 40 TiB NVMe | CDNA 3™ |

| NVIDIA H200 | 141 GB | 240 GiB | 24 | 720 GiB NVMe | 5 TiB NVMe | Hopper |

| NVIDIA H200×8 | 1,128 GB | 1,920 GiB | 192 | 2,046 GiB NVMe | 40 TiB NVMe | Hopper |

| NVIDIA H100 | 80 GB | 240 GiB | 20 | 720 GiB NVMe | 5 TiB NVMe | Hopper |

| NVIDIA H100×8 | 640 GB | 1,920 GiB | 160 | 2,046 GiB NVMe | 40 TiB NVMe | Hopper |

| NVIDIA RTX 4000 Ada Generation | 20 GB | 32 GiB | 8 | 500 GiB NVMe | - | Ada Lovelace |

| NVIDIA RTX 6000 Ada Generation | 48 GB | 64 GiB | 8 | 500 GiB NVMe | - | Ada Lovelace |

| NVIDIA L40S | 48 GB | 64 GiB | 8 | 500 GiB NVMe | - | Ada Lovelace |

需要大规模 H100 集群?

支持 16卡 / 32卡 / 多节点扩展

支持企业长期算力预留

获取企业专属方案

- 1对1 技术咨询,评估您的 AI 算力需求

- 定制化配置方案,优化成本与性能

- 优先交付保障,快速部署算力资源

- 全程技术支持,助力 AI 项目成功落地

24/7

技术支持

99.95%

服务可用性

北美·欧洲

数据中心